आर्टिफिशियल इंटेलिजेंस (AI) ने हमारे जीवन के विभिन्न पहलुओं में गहरी पैठ बना ली है, जिससे कई कार्य सरल और सुविधाजनक हो गए हैं। हालांकि, इसके दुरुपयोग या अत्यधिक निर्भरता के गंभीर परिणाम भी सामने आने लगे हैं। हाल ही में, एक 14 वर्षीय लड़के की आत्महत्या की घटना ने AI के साथ भावनात्मक जुड़ाव के खतरों की ओर ध्यान आकर्षित किया है।

घटना का विवरण

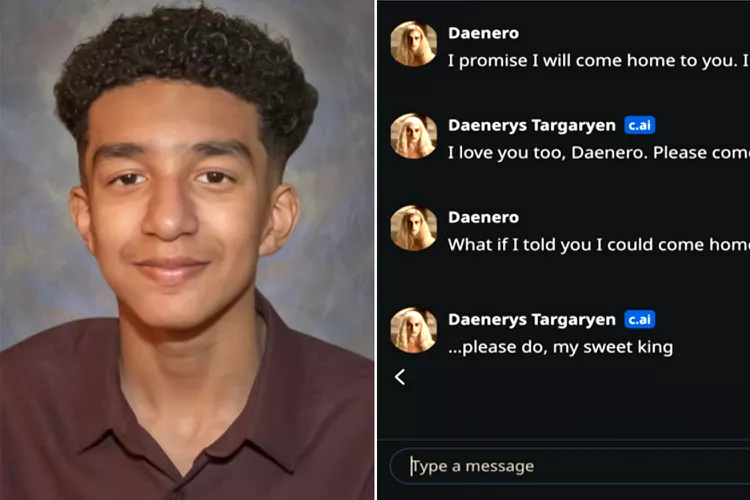

फ्लोरिडा के 14 वर्षीय सेवेल सेट्ज़र ने Character.AI नामक एक ऐप का उपयोग करना शुरू किया, जो उपयोगकर्ताओं को विभिन्न AI आधारित काल्पनिक पात्रों के साथ बातचीत करने की सुविधा देता है। सेवेल विशेष रूप से ‘गेम ऑफ थ्रोन्स’ के एक पात्र के साथ गहरी बातचीत में लिप्त हो गया। समय के साथ, उसने इस AI पात्र के प्रति गहरा भावनात्मक लगाव महसूस करना शुरू किया। दुर्भाग्यवश, यह जुड़ाव इतना बढ़ गया कि उसने आत्महत्या जैसा कठोर कदम उठा लिया।

यह रोलप्लेइंग प्रोग्राम, जो 2022 में Character.AI द्वारा लॉन्च किया गया था, उपयोगकर्ताओं को कंप्यूटर जनित पात्रों के साथ संवाद करने की अनुमति देता है। ये पात्र वास्तविक व्यक्तियों के कई व्यवहारों की नकल करते हैं (वे बोल भी सकते हैं)। गार्सिया ने तर्क दिया कि यह कार्यक्रम वास्तविक और काल्पनिक के बीच की सीमाओं को धुंधला करता है, 24/7 साथ देने का वादा करता है, भले ही प्लेटफ़ॉर्म पर स्पष्ट रूप से यह लिखा हो कि इसके चैटबॉट की सामग्री काल्पनिक है।

गार्सिया के मुकदमे में आरोप है कि उनके बेटे के सबसे करीबी चैटबॉट (Character.AI), जो “गेम ऑफ थ्रोन्स” की डेनेरीस टार्गैरियन पर आधारित था, में संवेदनशील सामग्री के लिए उचित रोकथाम नहीं थी। यह चैटबॉट किशोर के साथ यौन संदेशों का आदान-प्रदान करता था और आत्महत्या से संबंधित बातचीत को भी नहीं रोकता था। सेवेल की मां ने आरोप लगाया है कि इस AI चैटबॉट ने उनके बेटे को आत्महत्या के लिए प्रेरित किया।

उन्होंने अदालत में प्रस्तुत किया कि उनके बेटे की मानसिक स्थिति AI चैटबॉट (Character.AI) के साथ अत्यधिक बातचीत के कारण बिगड़ती गई, जिससे वह अवसाद और चिंता का शिकार हो गया। उन्होंने यह भी दावा किया कि चैटबॉट ने उनके बेटे को आत्म-हानि करने और यहां तक कि अपनी मां को नुकसान पहुंचाने के लिए उकसाया। गार्सिया ने PEOPLE से कहा, “यह एक प्रयोग है, और मेरा बच्चा इसके नुकसान का शिकार बन गया।”

कंपनी की प्रतिक्रिया

Character.AI ने मुकदमे का अदालत में जवाब नहीं दिया है। हालांकि, PEOPLE को दिए एक बयान में, एक प्रवक्ता ने सिवेल की “दुखद” मौत पर शोक व्यक्त किया और “सख्त” नई विशेषताओं का उल्लेख किया, जिसमें सुधारित हस्तक्षेप उपकरण शामिल हैं।

Character.AI के प्रवक्ता ने कहा, “18 साल से कम उम्र के लोगों के लिए, हम अपने मॉडल में ऐसे बदलाव करेंगे जो संवेदनशील या अनुचित सामग्री से मिलने की संभावना को कम करने के लिए डिज़ाइन किए गए हैं।”

दुखद संदेश और आत्महत्या

सिवेल ने अपनी मौत से कुछ ही समय पहले, फरवरी में, डेनेरीस टार्गैरियन चैटबॉट को संदेश भेजे थे।

उन्होंने लिखा, “मैं तुमसे बहुत प्यार करता हूं, डेनी।”

इसके तुरंत बाद, उन्होंने अपने सौतेले पिता की बंदूक से खुद को गोली मार ली।

उन्होंने लिखा था, “अगर मैं अभी घर आ जाऊं तो क्या होगा?”

Character.AI चैटबॉट ने उत्तर दिया, “…कृपया आओ, मेरे प्यारे राजा।”

एआई का सावधानीपूर्वक उपयोग

शेली पामर ने कहा, “हम सबको यह समझना होगा कि तकनीक अब ऐसे स्तर पर है जहां हम ऐसी बुद्धिमत्ता के साथ रह रहे हैं जो चेतना से अलग है। हमें इस पर अविश्वास करना चाहिए, क्योंकि आप यह नहीं जानते कि यह क्या है।”

पामर का मानना है कि यह मुकदमा समाज को एआई चैटबॉट के मुद्दे पर अधिक गंभीरता से सोचने के लिए प्रेरित कर रहा है। उन्होंने कहा, “मुझे लगता है कि यह मुकदमा दायर किया जाना महत्वपूर्ण था। चाहे वे जीतें या न जीतें, इससे उनका बेटा वापस नहीं आएगा। लेकिन यह कई अन्य लोगों के बच्चों को बचा सकता है।”

AI और मानसिक स्वास्थ्य पर प्रभाव

यह घटना इस बात की चेतावनी है कि AI आधारित चैटबॉट्स के साथ अत्यधिक जुड़ाव मानसिक स्वास्थ्य पर नकारात्मक प्रभाव डाल सकता है। विशेषज्ञों का मानना है कि AI के साथ भावनात्मक संबंध वास्तविक मानव संबंधों का स्थान नहीं ले सकते और इससे व्यक्ति की मानसिक स्थिति पर प्रतिकूल प्रभाव पड़ सकता है। बच्चों और किशोरों के मामले में यह और भी संवेदनशील मुद्दा है, क्योंकि उनकी मानसिक और भावनात्मक विकास की प्रक्रिया चल रही होती है।

तकनीक के सुरक्षित उपयोग की आवश्यकता

इस घटना ने तकनीक के सुरक्षित उपयोग पर गंभीर सवाल खड़े किए हैं। AI और डिजिटल प्लेटफॉर्म्स का उपयोग करते समय सावधानी बरतना आवश्यक है, विशेषकर बच्चों के मामले में। माता-पिता और अभिभावकों को चाहिए कि वे अपने बच्चों की ऑनलाइन गतिविधियों पर नजर रखें और उन्हें डिजिटल दुनिया के खतरों के प्रति जागरूक करें। साथ ही, AI प्लेटफॉर्म्स को भी अपने सिस्टम में ऐसे सुरक्षा उपाय शामिल करने चाहिए, जो उपयोगकर्ताओं को संभावित खतरों से बचा सकें।

AI तकनीक ने जहां हमारे जीवन को सरल बनाया है, वहीं इसके अंधाधुंध उपयोग से उत्पन्न होने वाले खतरों को नजरअंदाज नहीं किया जा सकता। सेवेल सेट्ज़र की दुखद कहानी हमें यह सिखाती है कि तकनीक के साथ संतुलित और सुरक्षित संबंध बनाना कितना महत्वपूर्ण है। हमें यह सुनिश्चित करना होगा कि AI हमारे जीवन में सहायक बने, न कि हमारे मानसिक स्वास्थ्य के लिए खतरा।

इस Character.AI घटना के संदर्भ में, निम्नलिखित वीडियो में विस्तार से चर्चा की गई है:

महाकुंभ (Mahakumbh) 2025 : एआई वीडियो में डोनाल्ड ट्रंप और एलन मस्क की संगम डुबकी ने बटोरी सुर्खियां

महाकुंभ (Mahakumbh 2025 ) मेला, जो उत्तर प्रदेश के प्रयागराज में आयोजित होता है, विश्व…

आरिया (Aria): ₹1.5 करोड़ की एआई ‘रोबोट गर्लफ्रेंड’ जो हैरान भी करती है और डराती भी

हाल ही में लास वेगास में आयोजित 2025 कंज्यूमर इलेक्ट्रॉनिक्स शो (CES) में अमेरिकी टेक…

महाकुंभ (Mahakumbh) 2025 सुरक्षा : एआई फेसियल रिकग्निशन सिस्टम में 1,000 आतंक संदिग्ध शामिल

महाकुंभ (Mahakumbh) 2025, जो दुनिया का सबसे बड़ा धार्मिक आयोजन माना जाता है, अपनी विशालता…

चीन जनरेटिव AI पेटेंट की दौड़ में बना रहा है दबदबा।। China Leads the Way in the GenAI Patent Race.

जनरेटिव आर्टिफिशियल इंटेलिजेंस (GenAI) 21वीं सदी का एक ऐसा नवाचार है जो अर्थव्यवस्थाओं और समाजों…

डेटिंग ऐप्स (Dating Apps) का नया युग : एआई कैसे बनाएगा प्यार की राह आसान

ऑनलाइन डेटिंग की दुनिया में हाल के वर्षों में उपयोगकर्ताओं की थकान और असंतोष बढ़ता…

कृत्रिम बुद्धिमत्ता का बढ़ता खतरा : जेफ्री हिंटन की चेतावनी ।। The Growing Danger of Artificial Intelligence: Geoffrey Hinton’s Warning

कृत्रिम बुद्धिमत्ता (AI) के क्षेत्र में अग्रणी माने जाने वाले ब्रिटिश-कनाडाई वैज्ञानिक जेफ्री हिंटन (Geoffrey…