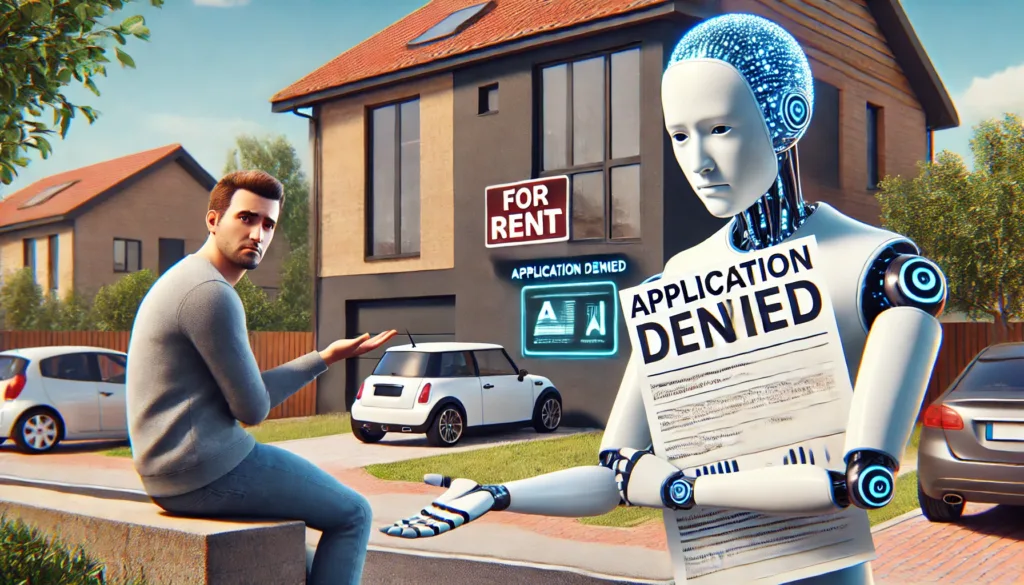

आधुनिक युग में, कृत्रिम बुद्धिमत्ता (AI) ने हमारे जीवन के कई क्षेत्रों में क्रांति ला दी है। हालांकि, हाल ही में AI के उपयोग पर सवाल खड़े हुए हैं, विशेषकर तब, जब इसका उपयोग भेदभावपूर्ण निर्णय लेने के लिए किया जाता है। ऐसा ही एक मामला SafeRent Solutions से जुड़ा है, जो किरायेदारों की स्क्रीनिंग के लिए AI-आधारित प्रणाली का उपयोग करती है। यह मामला मैरी लुइस, एक अनुभवी किरायेदार, और Section 8 वाउचर का उपयोग करने वाले 400 से अधिक वादियों द्वारा दायर मुकदमे के बाद चर्चा में आया। इस विवाद ने न केवल AI प्रणाली की खामियों को उजागर किया, बल्कि नस्लीय और आर्थिक असमानताओं पर भी प्रकाश डाला।

मामला: मैरी लुइस का अनुभव

2021 में, मैरी लुइस, जो एक सुरक्षा गार्ड के रूप में काम करती हैं, ने एक अपार्टमेंट के लिए आवेदन किया। उन्होंने 17 वर्षों तक एक ही मकान में समय पर किराया चुकाया था और उनके मकान मालिक ने उनकी एक मजबूत सिफारिश दी थी। इसके बावजूद, SafeRent की AI प्रणाली ने उन्हें 324 का स्कोर दिया, जो न्यूनतम 443 से कम था।

SafeRent की रिपोर्ट ने न केवल इस स्कोर को अस्वीकार किया बल्कि यह भी स्पष्ट नहीं किया कि यह स्कोर कैसे निर्धारित किया गया था। महत्वपूर्ण बात यह है कि लुइस Section 8 वाउचर का उपयोग कर रही थीं, जो मकान मालिकों को सरकारी भुगतान की गारंटी देता है। इसके बावजूद, उनके आवेदन को “अस्वीकृत” कर दिया गया, बिना किसी अपील के विकल्प के।

SafeRent के खिलाफ आरोप

लुइस और अन्य वादियों ने SafeRent पर आरोप लगाया कि इसका एल्गोरिद्म उन कारकों को प्राथमिकता देता है जो किसी व्यक्ति की किरायेदारी की क्षमता के लिए अप्रासंगिक हैं, जैसे क्रेडिट स्कोर और गैर-आवासीय ऋण। आरोपों में यह भी शामिल था कि SafeRent का सिस्टम Black और Hispanic समुदाय के किरायेदारों के साथ भेदभाव करता है, क्योंकि वे कम क्रेडिट स्कोर और सरकारी वाउचर पर अधिक निर्भर होते हैं।

मुकदमा और कानूनी दावों का विवरण

2022 में शुरू हुआ यह मुकदमा Fair Housing Act के तहत दायर किया गया। वादियों ने आरोप लगाया कि SafeRent की एल्गोरिद्म प्रणाली Fair Housing कानूनों का उल्लंघन करती है, जो नस्लीय, जातीय, और आर्थिक आधार पर भेदभाव को प्रतिबंधित करता है।

प्रमुख दावे:

- SafeRent का स्कोरिंग मॉडल पारदर्शी नहीं है।

- यह प्रणाली सरकारी वाउचर को सकारात्मक वित्तीय गारंटी के रूप में मानने में विफल रही।

- वाउचर धारकों के साथ प्रणालीगत भेदभाव किया गया।

SafeRent का बचाव और अंतिम समझौता

SafeRent ने इन आरोपों से इनकार करते हुए कहा कि उनका सिस्टम सभी कानूनों का पालन करता है। लेकिन कंपनी ने स्वीकार किया कि मुकदमेबाजी में समय और संसाधनों की लागत अधिक है। नवंबर 2024 में, SafeRent ने $2.3 मिलियन के भुगतान पर सहमति दी और अगले पांच वर्षों तक Section 8 वाउचर उपयोगकर्ताओं के लिए अपने स्कोरिंग सिस्टम को निलंबित करने का निर्णय लिया।

इस समझौते की कुछ प्रमुख शर्तें थीं:

- SafeRent अब वाउचर धारकों के लिए “स्वीकृत” या “अस्वीकृत” की सिफारिशें नहीं देगा।

- भविष्य में, अगर कोई नई स्कोरिंग प्रणाली बनाई जाती है, तो उसे स्वतंत्र जांच और सत्यापन की आवश्यकता होगी।

मामला क्यों महत्वपूर्ण है?

1. AI प्रणाली में पारदर्शिता की कमी

यह मामला दिखाता है कि कैसे AI प्रणाली निर्णय लेने में पारदर्शिता की कमी के कारण विवाद का कारण बन सकती है। SafeRent के एल्गोरिद्म ने न केवल अपने मापदंडों को छिपाया बल्कि इसमें अपील का कोई विकल्प भी नहीं था।

2. नस्लीय और आर्थिक प्रभाव

यह मामला स्पष्ट करता है कि Black और Hispanic किरायेदारों को, जो वाउचर पर निर्भर हैं, अक्सर अनुचित स्कोरिंग का सामना करना पड़ता है। यह मुद्दा AI-आधारित प्रणाली में पूर्वाग्रह को दूर करने की आवश्यकता पर जोर देता है।

3. वाउचर धारकों के अधिकार

इस समझौते ने Section 8 वाउचर धारकों के लिए न्याय का मार्ग प्रशस्त किया है। यह उनके अधिकारों की रक्षा करता है और सुनिश्चित करता है कि मकान मालिक उन्हें केवल एक एल्गोरिद्म के आधार पर अस्वीकार नहीं कर सकते।

सामाजिक और कानूनी प्रभाव

किरायेदारी की प्रक्रिया में सुधार

यह मामला भविष्य में AI और मकान मालिकों के व्यवहार को सुधारने का मार्ग दिखाता है। व्यक्तिगत जांच पर जोर देकर यह प्रणाली किरायेदारों को निष्पक्षता प्रदान कर सकती है।

AI नियमन की आवश्यकता

यह मुकदमा AI सिस्टम के नियमन की बढ़ती आवश्यकता को रेखांकित करता है। इसे सुनिश्चित करना होगा कि एल्गोरिद्म में भेदभाव न हो और यह सभी समुदायों के लिए निष्पक्ष हो।

AI और मानवाधिकार

SafeRent विवाद AI तकनीक और मानवाधिकारों के बीच संतुलन का उदाहरण बन गया है। यह सुनिश्चित करना आवश्यक है कि तकनीक, जो निर्णय लेने में सहायक हो सकती है, किसी भी समुदाय के साथ अन्याय न करे।

SafeRent विवाद ने न केवल AI प्रणाली की खामियों को उजागर किया, बल्कि यह भी दिखाया कि किस तरह तकनीक का दुरुपयोग समाज के सबसे कमजोर वर्गों को प्रभावित कर सकता है। इस मामले का परिणाम, जिसमें SafeRent को $2.3 मिलियन का भुगतान और स्कोरिंग प्रणाली बंद करनी पड़ी, एक ऐतिहासिक कदम है।

यह घटना हमें याद दिलाती है कि प्रौद्योगिकी केवल एक उपकरण है। इसका उपयोग सही इरादे और स्पष्ट मापदंडों के साथ करना चाहिए। AI और मानवाधिकारों के बीच यह संघर्ष हमें भविष्य में तकनीकी विकास के लिए जिम्मेदार मार्गदर्शन देता है।

महाकुंभ (Mahakumbh) 2025 : एआई वीडियो में डोनाल्ड ट्रंप और एलन मस्क की संगम डुबकी ने बटोरी सुर्खियां

महाकुंभ (Mahakumbh 2025 ) मेला, जो उत्तर प्रदेश के प्रयागराज में आयोजित होता है, विश्व…

आरिया (Aria): ₹1.5 करोड़ की एआई ‘रोबोट गर्लफ्रेंड’ जो हैरान भी करती है और डराती भी

हाल ही में लास वेगास में आयोजित 2025 कंज्यूमर इलेक्ट्रॉनिक्स शो (CES) में अमेरिकी टेक…

महाकुंभ (Mahakumbh) 2025 सुरक्षा : एआई फेसियल रिकग्निशन सिस्टम में 1,000 आतंक संदिग्ध शामिल

महाकुंभ (Mahakumbh) 2025, जो दुनिया का सबसे बड़ा धार्मिक आयोजन माना जाता है, अपनी विशालता…

चीन जनरेटिव AI पेटेंट की दौड़ में बना रहा है दबदबा।। China Leads the Way in the GenAI Patent Race.

जनरेटिव आर्टिफिशियल इंटेलिजेंस (GenAI) 21वीं सदी का एक ऐसा नवाचार है जो अर्थव्यवस्थाओं और समाजों…

डेटिंग ऐप्स (Dating Apps) का नया युग : एआई कैसे बनाएगा प्यार की राह आसान

ऑनलाइन डेटिंग की दुनिया में हाल के वर्षों में उपयोगकर्ताओं की थकान और असंतोष बढ़ता…

कृत्रिम बुद्धिमत्ता का बढ़ता खतरा : जेफ्री हिंटन की चेतावनी ।। The Growing Danger of Artificial Intelligence: Geoffrey Hinton’s Warning

कृत्रिम बुद्धिमत्ता (AI) के क्षेत्र में अग्रणी माने जाने वाले ब्रिटिश-कनाडाई वैज्ञानिक जेफ्री हिंटन (Geoffrey…